AI đang đánh cắp dữ liệu của bạn – Các chuyên gia nói

Ngày 23/01/2024 - 03:01Tin tức gần đây về vụ rò rỉ ô trò chuyện của người dùng trên ChatGPT và các sự cố vi phạm dữ liệu khác đã khiến người dùng càng lo lắng và cảnh giác hơn về quyền riêng tư của họ. Giữa tất cả những nhầm lẫn và lo ngại về an toàn dữ liệu và quyền riêng tư trên nền tảng AI, chúng tôi đã liên hệ với một số nhà lãnh đạo ngành để xin ý kiến chuyên môn của họ về bảo mật dữ liệu trong kỷ nguyên AI .

Bài viết này sẽ đề cập đến các chủ đề từ việc phát triển và sử dụng bộ dữ liệu đào tạo AI cho đến đạo đức chia sẻ tài sản trí tuệ của AI. Chúng tôi sẽ điều tra tính an toàn của việc sử dụng nền tảng AI và xác định các phương pháp hay nhất để tăng cường bảo mật dữ liệu.

Vi phạm dữ liệu trên nền tảng AI

Bảo mật dữ liệu và quyền riêng tư luôn là khía cạnh cơ bản của mọi nền tảng kỹ thuật số. Với những tiến bộ trong trí tuệ nhân tạo, giờ đây nó càng trở nên quan trọng hơn. Việc xử lý và lưu trữ dữ liệu một cách an toàn trên nền tảng AI là rất quan trọng để ngăn chặn dữ liệu rơi vào tay kẻ xấu hoặc bị lạm dụng. Với loại và lượng dữ liệu được lưu trữ trên các nền tảng này, việc vi phạm dữ liệu có thể gây bất lợi cho các cá nhân, công ty hoặc thậm chí cả chính phủ.

Vi phạm dữ liệu cũng có thể làm tổn hại đến các thuật toán AI được sử dụng trong nền tảng, dẫn đến những dự đoán và hiểu biết không chính xác. Điều này có thể gây ra hậu quả đáng kể trong nhiều lĩnh vực khác nhau, chẳng hạn như tài chính , tiếp thị và bảo mật. Những dự đoán và hiểu biết không chính xác có thể dẫn đến tổn thất tài chính, thiệt hại về danh tiếng và các mối đe dọa an ninh.

Trước khi thảo luận chi tiết về bảo mật dữ liệu trên nền tảng AI, trước tiên chúng ta phải hiểu loại dữ liệu nào được sử dụng trong phát triển AI . Nền tảng AI được đào tạo trên các bộ dữ liệu lớn bao gồm tất cả và bất kỳ thông tin nào được công bố trực tuyến trong những năm qua. Điều này bao gồm dữ liệu từ nhiều nguồn khác nhau như công cụ tìm kiếm, nền tảng truyền thông xã hội, chatbot, biểu mẫu trực tuyến, v.v.

Các thuật toán AI xử lý tất cả dữ liệu được thu thập này và giúp máy học ngôn ngữ của con người, tạo ra thông tin chi tiết và đưa ra dự đoán hợp lý. Nền tảng AI đào tạo trên cơ sở dữ liệu mới từ các truy vấn tìm kiếm và phản hồi sau khi ra mắt.

Mối quan tâm về quyền riêng tư dữ liệu trên nền tảng AI

Hôm nọ, tôi và bạn tôi đang ngồi trong phòng khách, với thiết bị trợ lý gia đình ở trong góc và điện thoại của chúng tôi trên bàn. Trong số nhiều điều chúng tôi thảo luận ngày hôm đó, có chuyến đi gần đây của cô ấy đến Thổ Nhĩ Kỳ. Thật ngạc nhiên, ngày hôm sau, Google bắt đầu hiển thị cho tôi quảng cáo về các gói du lịch đến Thổ Nhĩ Kỳ. Sự việc này nghe có vẻ quen thuộc với bạn phải không?

Tôi chắc chắn rất sợ hãi khi cảm thấy mình đang bị theo dõi bởi tất cả các thiết bị công nghệ xung quanh mình. Những cuộc trò chuyện riêng tư của tôi không còn có cảm giác riêng tư nữa. Và đó là lần đầu tiên tôi suy nghĩ nghiêm túc về vấn đề bảo mật và quyền riêng tư dữ liệu.

Ông Kunal Jain, Giám đốc điều hành của Analytics Vidhya, đã chia sẻ một câu chuyện tương tự với chúng tôi, đồng thời nói thêm rằng trải nghiệm của ông đã khiến ông cảnh giác với các thiết bị ông sử dụng ở nhà. Anh ta cũng là đối tượng của những quảng cáo nhắm mục tiêu dựa trên những cuộc trò chuyện riêng tư ở nhà. Như một biện pháp phòng ngừa, giờ đây anh đảm bảo rằng các bề mặt trợ lý gia đình chỉ được bật khi được yêu cầu và không có cuộc trò chuyện cá nhân nào được thực hiện khi chúng đang được sử dụng. Đây là quy tắc an toàn mà tất cả chúng ta đều có thể tuân theo vì các thiết bị cá nhân của chúng ta có thể nghe thấy chúng ta; đặc biệt là vì tất cả các thiết bị của chúng tôi đều được kết nối.

Khi nói chuyện với ông Debdoot Mukherjee (Giám đốc nhà khoa học dữ liệu, Meesho) về vấn đề này, ông đồng ý rằng việc sử dụng dữ liệu cá nhân theo cách như vậy là vi phạm quyền riêng tư. Ông nói thêm rằng hầu hết mọi người không biết rằng khi điện thoại di động hoặc các thiết bị khác của họ chỉ nằm xung quanh, họ (các thiết bị) đang lắng nghe các chuyển đổi của họ và có thể ghi lại chúng vào cơ sở dữ liệu.

XEM THÊM: Tận dụng tài khoản ChatGPT Plus để nâng cao khả năng AI và trải nghiệm công nghệ tiên tiến.

Đồng ý chia sẻ dữ liệu

Bây giờ câu hỏi đặt ra là liệu chúng ta có được yêu cầu hoặc yêu cầu trước khi sử dụng dữ liệu của mình để phát triển AI hay không và nếu được thông báo, chúng ta sẵn sàng hoặc cởi mở như thế nào trong việc đóng góp cho các tập dữ liệu đào tạo? Trả lời câu hỏi này, ông Jain nói: “Không ai trong chúng tôi được thông báo rằng dữ liệu hoặc cơ sở dữ liệu mà chúng tôi giúp xây dựng đang được sử dụng để phát triển AI. Nó chưa được đồng ý một cách rõ ràng.”

Anh ấy giải thích rằng ChatGPT-4 được đào tạo về học tăng cường dựa trên con người chứ không chỉ học tăng cường dựa trên máy, vốn yêu cầu quyền truy cập vào dữ liệu của chúng tôi. “Mọi sản phẩm đều hoạt động dựa trên phản hồi để cải thiện. Nếu tôi được thông báo rằng bất kỳ dữ liệu nào tôi chia sẻ sẽ được sử dụng để đào tạo hoặc cải thiện nền tảng AI, tôi sẽ rất vui được trở thành một phần trong đó.”, anh ấy nói thêm.

Ông Ajoy Singh, COO và Giám đốc AI tại Fractal Analytics, nói rằng về mặt đạo đức, tất cả AI phải được đào tạo về dữ liệu có sẵn công khai, không phải dữ liệu riêng tư hoặc cá nhân. Nhưng bây giờ mọi việc đã diễn ra như vậy, ít nhất mọi người cũng cần được thông báo về điều này. Ông giải thích thêm rằng tất cả đều bắt nguồn từ việc xin phép trước khi truy cập hoặc sử dụng dữ liệu riêng tư của ai đó.

Ông nói: “Mọi người giờ đây đã cởi mở hơn trong việc chia sẻ cuộc sống cá nhân của họ trực tuyến, đồng thời cảm thấy khó chịu khi dữ liệu của họ bị chia sẻ hoặc sử dụng cho mục đích đào tạo AI”. Ông cho biết thêm: “90% mọi người không biết rằng các lệnh của họ đối với tất cả các AI này – Siri, Alexa, Google Assistant, v.v. – đang được ghi lại”. Do đó, ngoài việc chia sẻ dữ liệu cá nhân, việc thiếu sự đồng ý sẽ xúc phạm mọi người.

Điều đó giải thích sự phẫn nộ của mọi người khi Google tuyên bố rằng dữ liệu của người dùng Gmail đã được sử dụng [mà không có sự đồng ý của họ] để đào tạo AI đàm thoại của họ, Bard. Theo ông Singh, minh bạch là con đường nên đi. “Các công ty phải minh bạch trong việc sử dụng dữ liệu của chúng tôi. Họ nên làm rõ cho chúng tôi những tùy chọn nào chúng tôi có để bật hoặc tắt tính năng chia sẻ dữ liệu và loại dữ liệu nào họ đang lấy từ chúng tôi.”, ông nói.

Quyền riêng tư của chúng tôi bị vi phạm khi các trang web lưu trữ dữ liệu của chúng tôi mà không được phép và các nhà phát triển sử dụng dữ liệu đó để đào tạo mô hình của họ. Do đó, quyền riêng tư dữ liệu trong kỷ nguyên AI phụ thuộc vào sự đồng ý của người dùng. Mọi người nên được hỏi rõ ràng và đưa ra lựa chọn để quyết định xem họ có muốn chia sẻ dữ liệu của mình hay không.

Đảm bảo an toàn dữ liệu trên nền tảng AI

Giờ đây, chúng tôi đã hiểu tầm quan trọng của việc bảo mật dữ liệu trên nền tảng AI và các rủi ro tiềm ẩn khi vi phạm dữ liệu, làm cách nào chúng tôi có thể đảm bảo dữ liệu của mình được chia sẻ an toàn?

Ông Jain nói rằng về mặt kiến trúc, các nhà phát triển sẽ đóng tất cả các lỗ hổng có thể khiến dữ liệu riêng tư bị ai đó sử dụng AI truy cập. Hơn nữa, AI được đào tạo về nội dung bị che giấu, chỉ chia sẻ dữ liệu văn bản hoặc ngôn ngữ chứ không chia sẻ ai đã nói gì. Nói cách khác, AI sử dụng dữ liệu để học xử lý ngôn ngữ và không thể theo dõi lại những cá nhân đã cung cấp dữ liệu đó. Ông nói, tại thời điểm này, sẽ rất ngạc nhiên khi thấy AI liên kết cuộc trò chuyện với một cá nhân hoặc thực thể cụ thể hoặc nếu có ai đó lấy được thông tin như vậy từ AI.

Hiện tại, các nền tảng AI đã có sẵn một số biện pháp nhất định để đảm bảo an toàn dữ liệu. Thứ nhất, các công cụ AI được xây dựng với các biện pháp kiểm soát truy cập nhằm hạn chế quyền truy cập vào dữ liệu. Kiểm tra bảo mật thường xuyên cũng được tiến hành để giúp xác định bất kỳ lỗ hổng tiềm ẩn nào trong hệ thống. Hơn nữa, các kỹ thuật mã hóa được sử dụng để đảm bảo rằng ngay cả khi dữ liệu bị xâm phạm, nó vẫn không thể được truy cập hoặc đọc nếu không có khóa mã hóa.

Ông Mukherjee nói rằng các công ty nghiên cứu và phát triển AI phải nhận thức được những vi phạm tiềm ẩn và lên kế hoạch phù hợp. Quan trọng hơn, ông nói rằng cần phải có luật và quy định [liên quan đến vấn đề này] để các công ty phải thực thi nghiêm ngặt.

Chúng ta cần hiểu tiềm năng của công nghệ AI và đặt ra các khung pháp lý xung quanh nó để đảm bảo tính bảo mật và quyền riêng tư dữ liệu đi đôi với tốc độ phát triển AI. Nhà phát triển, người dùng và cơ quan quản lý phải làm việc cùng nhau để đạt được điều này. Quan trọng hơn, các công ty phải đối mặt với hậu quả nếu mọi việc không được thực hiện đúng.

Nền tảng AI vẫn đang được phát triển và chúng chỉ cải thiện thông qua thử nghiệm, sai sót và phản hồi. Ông Singh cho biết: “Dây an toàn và túi khí cho AI tổng hợp sẽ sớm được phát triển,” ông Singh nói và mong muốn có một kỷ nguyên AI an toàn hơn.

Đào tạo dựa trên AI an toàn như thế nào đối với con người?

Trí tuệ nhân tạo đang phát triển với tốc độ nhanh đến mức các nền tảng AI do con người xây dựng và đào tạo giờ đây có khả năng dạy và đào tạo con người. Các nền tảng học tập trực tuyến, như Duolingo và Khan Academy, đã tích hợp các bot dựa trên ChatGPT vào hệ thống giảng dạy của họ và những nền tảng khác dường như cũng đang làm theo. Từ thời điểm con người cung cấp thông tin vào AI, giờ đây chúng ta đang chuyển sang thời đại mà AI sẽ được sử dụng để giáo dục con người.

Ông Jain nhận thấy nền tảng trí tuệ nhân tạo là nền tảng gia sư kiên nhẫn nhất. “Cho dù học sinh mất bao lâu để nắm bắt một khái niệm hoặc bao nhiêu lần điều tương tự cần được lặp lại, AI sẽ không bị xúc động hay mất kiên nhẫn [không giống như giáo viên con người]. AI vẫn sẽ nỗ lực giúp học sinh tiến gần hơn đến câu trả lời.”, ông nói. Thêm một lợi ích khác của việc học tập dựa trên AI, ông cho biết nó có thể tùy chỉnh phương pháp giảng dạy tùy thuộc vào mức độ hiểu biết của học sinh.

Bây giờ, điều đó có nghĩa là trong tương lai, giáo viên con người sẽ được thay thế bởi nền tảng AI? Không thực sự. Ông Jain chắc chắn rằng không thể thay thế được sự tiếp xúc của con người, và vì vậy AI, nếu được sử dụng, sẽ chỉ là một trợ lý xuất sắc cho các gia sư là con người.

Tất cả những gì đã nói, anh ấy cũng chia sẻ nỗi lo sợ của mình về điểm yếu và khả năng của một người bị khai thác để tạo ra một sản phẩm mục tiêu. Ông nói: “Không nên sử dụng kiến thức của AI về những khuyết điểm của học sinh để tiếp thị có mục tiêu hoặc phát triển sản phẩm. Ông nói thêm rằng, may mắn thay, chúng ta vẫn đang ở thời điểm có thể điều chỉnh và kiểm soát những khía cạnh này để giúp việc học AI trở nên an toàn hơn cho trẻ em và học sinh.

Nguồn: wire19

Đó thực sự là một bước tiến vượt bậc trong công nghệ AI; tuy nhiên, điều này lại đặt ra câu hỏi về sự an toàn. Biết rằng nội dung do các chatbot AI như ChatGPT tạo ra có thể có lỗi thực tế và chúng có thể được đào tạo để đưa ra thông tin sai lệch, vậy việc sử dụng các công cụ AI để đào tạo con người có an toàn không?

XEM THÊM: Tận dụng sức mạnh AI với tài khoản ChatGPT Plus – Nâng tầm công việc!

Ông Singh tin rằng việc sử dụng AI trong giáo dục dựa trên lý luận là khá an toàn và hiệu quả. Tuy nhiên, ông gợi ý rằng công nghệ AI không nên được sử dụng để đào tạo con người ở những nơi có nguy cơ tiềm ẩn đến tính mạng hoặc ở những nơi mà sai sót phải trả giá rất lớn - ví dụ như trong khoa học y tế hoặc đào tạo phi công.

Về sự an toàn của trẻ em khi sử dụng nền tảng AI giáo dục, ông cho rằng điều quan trọng là phải đào tạo những AI như vậy để phát hiện đầu vào không an toàn và đảm bảo đầu ra an toàn. Ông nói thêm rằng trẻ em cũng phải được dạy điều gì là đúng và sai trong thế giới kỹ thuật số cũng như những rủi ro tiềm ẩn khi chia sẻ dữ liệu riêng tư trên các nền tảng đó.

Vi phạm sở hữu trí tuệ trên nền tảng AI

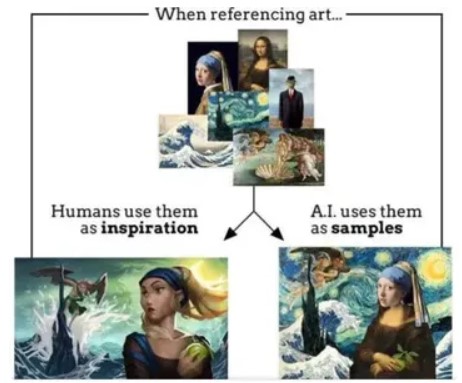

Nội dung do nền tảng AI tạo ra, nói về mặt đạo đức, là đạo văn trên quy mô lớn vì chúng không đi kèm với nguồn ghi công hoặc trích dẫn. Ông Jain cân nhắc thực tế là với quá nhiều nội dung do AI tạo ra ngoài kia, chúng ta không còn biết đâu là ranh giới cho hành vi đạo văn. Ngày nay, có rất nhiều bản sao và biến thể của cùng một thông tin trên internet – có thể là âm nhạc, tác phẩm nghệ thuật, văn bản hoặc hình ảnh – đến nỗi việc truy tìm nguồn gốc của thông tin đó trở nên khó khăn.

Các đơn vị phát triển AI như OpenAI và Midjourney gần đây đã vướng vào các cuộc chiến pháp lý vì vi phạm bản quyền và đạo văn. Các nhà sáng tạo, nghệ sĩ và nhà phân phối phương tiện truyền thông kỹ thuật số đã đệ đơn kiện một số công cụ AI. Họ tuyên bố rằng tác phẩm nghệ thuật của họ đã được sao chép hoặc chỉnh sửa và sao chép bằng các công cụ AI tạo hình ảnh mà không ghi nhận bất kỳ khoản tín dụng nào cho họ. Trong khi một số người cho rằng đây là hành vi vi phạm quyền sở hữu trí tuệ thì những người khác lại coi đây là tác phẩm đầy cảm hứng.

Nguồn: creativindie

Ông Singh chia sẻ quan điểm của mình: “Nếu bạn nhìn vào quá trình tiến hóa của loài người, không có gì là nguyên bản cả. Mọi kiệt tác và sự phát triển đều được xây dựng dựa trên thứ đã tồn tại hoặc lấy cảm hứng từ thứ gì đó.” Vậy chúng ta có thể nói bao nhiêu trong số đó được sao chép và phần nào trong đó được truyền cảm hứng?

Phần kết luận

Trí tuệ nhân tạo đang phát triển với tốc độ nhanh nhất hiện nay. Dữ liệu được đưa vào các mô hình này trong quá trình đào tạo, thử nghiệm và triển khai sẽ quyết định cách chúng suy nghĩ và vận hành. Việc đào tạo AI về dữ liệu cá nhân có thể khiến nó có xu hướng suy nghĩ theo một cách cụ thể. Do đó, điều quan trọng là phải chọn dữ liệu đào tạo một cách cẩn thận. Như ông Singh nói, “Họ (AI) phải được đào tạo để tránh mọi thành kiến ảnh hưởng đến lợi ích toàn cầu hoặc chất lượng dịch vụ”.

Các nhà phát triển phải ưu tiên bảo mật dữ liệu để ngăn AI thao túng cá nhân và xâm phạm quyền riêng tư. Mặc dù đây là một kỷ nguyên thú vị nhưng cần phải thận trọng để tránh trở thành con tốt trong trò chơi AI. Với khả năng ngày càng mở rộng của AI, các tổ chức và người dùng AI chia sẻ trách nhiệm trao đổi dữ liệu an toàn và có đạo đức. Hãy để tầm nhìn phát triển AI minh bạch và an toàn dữ liệu sớm được hiện thực hóa hết tiềm năng của nó.

.jpg)

.jpg)

.jpg)

.jpg)

.png)

.png)

Bài viết liên quan

19/01/2024

03/01/2024

19/01/2024

24/01/2024

19/01/2024

04/02/2024